🎓

Chào mừng đến Cộng Đồng Giáo Dục Việt Nam 🎓

Tham gia ngay để kết nối giảng viên, học viên và chia sẻ tri thức cùng hàng nghìn thành viên khác!

Bạn đang sử dụng trình duyệt lỗi thời. Trình duyệt này có thể không hiển thị đúng trang web này hoặc các trang web khác.

Bạn nên nâng cấp hoặc sử dụng trình duyệt thay thế.

Bạn nên nâng cấp hoặc sử dụng trình duyệt thay thế.

📚 Luận văn – Bài báo khoa học

👉 Không gian chia sẻ, thảo luận và hỗ trợ nghiên cứu khoa học.

Trách nhiệm pháp lý của mô hình AI tự sinh nội dung: Khủng hoảng nền tảng của tư duy pháp lý trong thế giới bất cân xứng quyền lực

Thg 12 12

- 372

- 0

Trong lịch sử pháp luật, chưa bao giờ một công nghệ lại thách thức toàn diện hệ thống khái niệm, lý thuyết và nguyên tắc nền tảng như trí tuệ nhân tạo tự sinh nội dung (Generative AI). Khi luật dân sự, hình sự, hành chính và thông tin – truyền thông đều được xây dựng dựa trên tiền đề rằng hành vi gây hại có thể quy trách nhiệm cho một cá nhân hay tổ chức nhất định, sự xuất hiện của các mô hình AI phi tuyến tính, khó dự đoán, hoạt động như “hộp đen” đã làm lung lay nền tảng của toàn bộ hệ thống phân bổ trách nhiệm truyền thống. AI không có ý chí, không có động cơ, không có năng lực nhận thức; nó chỉ là cỗ máy sản xuất xác suất. Nhưng tác động của nó lên xã hội – từ hình ảnh giả mạo, deepfake, tin sai lệch, đến lời khuyên pháp lý sai, chẩn đoán y tế ảo, thao túng dư luận – lại thực tế, trực tiếp và có sức ảnh hưởng vượt xa khả năng dự phóng của bất kỳ thiết chế pháp lý nào.

Trong lịch sử pháp luật, chưa bao giờ một công nghệ lại thách thức toàn diện hệ thống khái niệm, lý thuyết và nguyên tắc nền tảng như trí tuệ nhân tạo tự sinh nội dung (Generative AI). Khi luật dân sự, hình sự, hành chính và thông tin – truyền thông đều được xây dựng dựa trên tiền đề rằng hành vi gây hại có thể quy trách nhiệm cho một cá nhân hay tổ chức nhất định, sự xuất hiện của các mô hình AI phi tuyến tính, khó dự đoán, hoạt động như “hộp đen” đã làm lung lay nền tảng của toàn bộ hệ thống phân bổ trách nhiệm truyền thống. AI không có ý chí, không có động cơ, không có năng lực nhận thức; nó chỉ là cỗ máy sản xuất xác suất. Nhưng tác động của nó lên xã hội – từ hình ảnh giả mạo, deepfake, tin sai lệch, đến lời khuyên pháp lý sai, chẩn đoán y tế ảo, thao túng dư luận – lại thực tế, trực tiếp và có sức ảnh hưởng vượt xa khả năng dự phóng của bất kỳ thiết chế pháp lý nào.Điều trớ trêu là chính những công...

Trí tuệ nhân tạo & Xã hội – Xu hướng

Thg 12 12

- 197

- 0

Tác giả: Trương Anh Vũ

Cơ quan:

Trí tuệ nhân tạo (AI) đang trở thành công nghệ nền tảng định hình mọi lĩnh vực của đời sống xã hội hiện đại. Bài báo này phân tích những xu hướng nổi bật của AI trong giai đoạn hiện nay, bao gồm AI tạo sinh, tự động hóa lao động tri thức, hệ sinh thái AI xã hội, các vấn đề đạo đức – pháp lý, cũng như sự chuyển đổi trong tương tác giữa con người và máy móc. Thông qua tổng hợp các nghiên cứu gần đây, bài báo chỉ ra rằng AI không chỉ là công cụ công nghệ mà còn là nhân tố thay đổi cấu trúc xã hội, mô hình sản xuất và hành vi con người. Cuối cùng, tác giả đề xuất một số hướng nghiên cứu và chính sách nhằm đảm bảo AI phục vụ sự phát triển bền vững.

Từ khóa: Trí tuệ nhân tạo, AI tạo sinh, tự động hóa, đạo đức AI, xã hội số, chính sách AI.

Cơ quan:

Tóm tắt

Tóm tắt

Trí tuệ nhân tạo (AI) đang trở thành công nghệ nền tảng định hình mọi lĩnh vực của đời sống xã hội hiện đại. Bài báo này phân tích những xu hướng nổi bật của AI trong giai đoạn hiện nay, bao gồm AI tạo sinh, tự động hóa lao động tri thức, hệ sinh thái AI xã hội, các vấn đề đạo đức – pháp lý, cũng như sự chuyển đổi trong tương tác giữa con người và máy móc. Thông qua tổng hợp các nghiên cứu gần đây, bài báo chỉ ra rằng AI không chỉ là công cụ công nghệ mà còn là nhân tố thay đổi cấu trúc xã hội, mô hình sản xuất và hành vi con người. Cuối cùng, tác giả đề xuất một số hướng nghiên cứu và chính sách nhằm đảm bảo AI phục vụ sự phát triển bền vững.Từ khóa: Trí tuệ nhân tạo, AI tạo sinh, tự động hóa, đạo đức AI, xã hội số, chính sách AI.

1. Giới thiệu

Trí tuệ nhân tạo (AI) đã chuyển từ giai đoạn...Vai trò Chiến lược của Quản lý Trực tiếp trong Việc Duy trì Nhân sự: Góc nhìn từ Xu hướng Lao động đương đại

Thg 12 11

- 394

- 0

Sự dịch chuyển trong tư duy và hành vi của lực lượng lao động hiện nay cho thấy doanh nghiệp không chỉ cần một chiến lược nhân sự linh hoạt, mà còn đòi hỏi một hệ thống quản trị nội bộ có khả năng tạo ra trải nghiệm tích cực cho nhân viên ở cấp độ sâu hơn. Trong bối cảnh đó, khảo sát Gallup (2023) đưa ra một phát hiện đáng chú ý: 75% nguyên nhân khiến nhân viên rời bỏ doanh nghiệp liên quan trực tiếp đến cách họ được quản lý. Con số này không chỉ phản ánh vai trò trọng yếu của người quản lý trực tiếp, mà còn chỉ ra một thực tế: quản trị nhân sự đang chuyển từ mô hình “hệ thống – chính sách” sang mô hình “trải nghiệm – quan hệ – phát triển”.

Điều này có ý nghĩa đặc biệt quan trọng khi xét đến sự trỗi dậy của lực lượng lao động trẻ, vốn ưu tiên trải nghiệm, sự công bằng và cảm giác được tôn trọng. Trong bối cảnh đó, người quản lý trực tiếp trở thành tác nhân chính quyết định chất lượng trải nghiệm của nhân viên. Họ không chỉ phân công công việc, mà còn định hình cảm nhận của...

Điều này có ý nghĩa đặc biệt quan trọng khi xét đến sự trỗi dậy của lực lượng lao động trẻ, vốn ưu tiên trải nghiệm, sự công bằng và cảm giác được tôn trọng. Trong bối cảnh đó, người quản lý trực tiếp trở thành tác nhân chính quyết định chất lượng trải nghiệm của nhân viên. Họ không chỉ phân công công việc, mà còn định hình cảm nhận của...

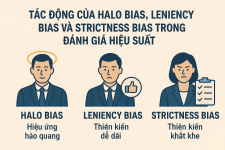

BBKH: Phân tích ảnh hưởng của Halo Bias, Leniency Bias và Strictness Bias trong đánh giá hiệu suất nhân viên

Thg 12 11

- 238

- 0

Tóm tắt

Đánh giá hiệu suất là hoạt động cốt lõi trong quản trị nhân sự, giúp tổ chức đo lường hiệu quả công việc, xác định nhu cầu đào tạo, phân bổ nguồn lực và ra quyết định thăng tiến. Tuy nhiên, tính khách quan của quá trình này thường bị ảnh hưởng bởi các thiên kiến nhận thức (cognitive biases). Nghiên cứu này phân tích ba dạng thiên kiến phổ biến trong đánh giá hiệu suất — halo bias, leniency bias và strictness bias — thông qua cách tiếp cận lý thuyết và phân tích hành vi. Kết quả chỉ ra rằng ba dạng thiên kiến không chỉ ảnh hưởng đến độ chính xác của dữ liệu đánh giá mà còn có tác động sâu sắc đến động lực cá nhân, văn hóa tổ chức và hiệu quả quản trị. Nghiên cứu đề xuất một số giải pháp nhằm giảm thiểu sai lệch trong đánh giá, bao gồm chuẩn hóa tiêu chí, áp dụng đánh giá đa nguồn và đào tạo nhà quản lý về thiên kiến nhận thức. Bài báo góp phần củng cố cơ sở lý thuyết liên quan đến ảnh hưởng của thành kiến trong môi trường tổ chức và gợi mở hướng...BÀI LUẬN: TÁC ĐỘNG CỦA HALO BIAS, LENIENCY BIAS VÀ STRICTNESS BIAS TRONG ĐÁNH GIÁ HIỆU SUẤT

Thg 12 11

- 240

- 0

Trong quản trị nhân sự hiện đại, đánh giá hiệu suất giữ vai trò then chốt đối với phát triển cá nhân và sự vận hành của tổ chức. Tuy nhiên, quá trình này không phải lúc nào cũng phản ánh khách quan năng lực thật sự của nhân viên. Nhiều nghiên cứu hành vi cho thấy việc đánh giá thường bị chi phối bởi những dạng thành kiến nhận thức mà người đánh giá không nhận ra. Ba thiên kiến phổ biến nhất trong bối cảnh này là halo bias, leniency bias và strictness bias. Việc phân tích sâu ba thành kiến này mang lại góc nhìn toàn diện về những sai lệch vô thức trong đánh giá và giúp đề xuất những giải pháp nhằm nâng cao tính công bằng trong quản trị hiệu suất.

Trong quản trị nhân sự hiện đại, đánh giá hiệu suất giữ vai trò then chốt đối với phát triển cá nhân và sự vận hành của tổ chức. Tuy nhiên, quá trình này không phải lúc nào cũng phản ánh khách quan năng lực thật sự của nhân viên. Nhiều nghiên cứu hành vi cho thấy việc đánh giá thường bị chi phối bởi những dạng thành kiến nhận thức mà người đánh giá không nhận ra. Ba thiên kiến phổ biến nhất trong bối cảnh này là halo bias, leniency bias và strictness bias. Việc phân tích sâu ba thành kiến này mang lại góc nhìn toàn diện về những sai lệch vô thức trong đánh giá và giúp đề xuất những giải pháp nhằm nâng cao tính công bằng trong quản trị hiệu suất.Trước hết, halo bias—còn được gọi là hiệu ứng hào quang—xuất hiện khi người đánh giá để một điểm mạnh nổi bật của cá nhân ảnh hưởng đến toàn bộ cách nhìn nhận các khía cạnh khác. Khi một nhân viên có kỹ năng giao tiếp xuất sắc, người quản...

Phòng Chat

Đang online

- No one is chatting at the moment.

Trending content

Thống kê diễn đàn

Xếp hạng chat

- There are no chatters in the top.